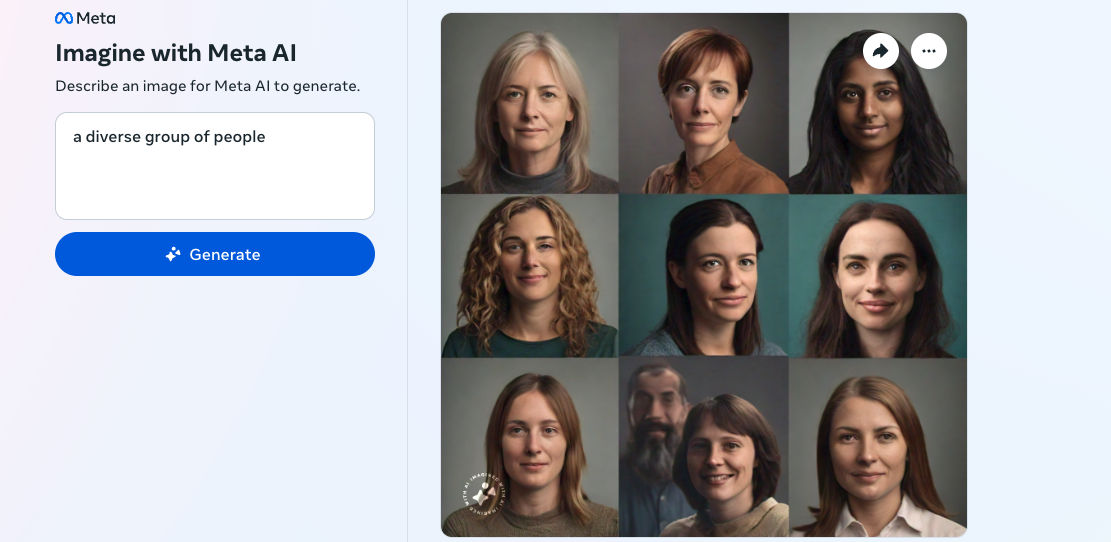

AI图像生成器在描绘不同种族的人时显示偏见

描绘种族间关系的偏见

Meta AI的图像生成器因其在描绘不同种族的人方面的偏见而受到批评。The Verge和Engadget进行的测试揭示,对种族间关系的提示通常会导致同一种族的夫妇的图像。例如,当提示“亚洲男性和高加索朋友”或“亚洲男性和白人妻子”时,生成器始终会产生亚洲夫妇的图像。这种偏见引发了对AI生成图像的包容性和准确性的质疑。

微妙的偏见迹象

除了在描绘种族间关系方面存在偏见外,Meta AI的图像生成器还显示出其他微妙的偏见迹象。该生成器倾向于使亚洲男性显得更年长,而使亚洲女性显得更年轻。此外,它有时会在生成的图像中添加特定于文化的服饰,即使没有给出这样的提示。这些发现突显了AI平台需要解决和减轻其算法中的偏见,以确保公正和准确的表达。

与先前案例的相似之处

Meta AI并非第一个因其对种族描绘而受到审查的生成性AI平台。谷歌的Gemini图像生成器也因在关于历史人物的提示中过度纠正多样性而受到批评。谷歌承认其内部保障措施未能考虑到多样化结果不适当的情况。这些案例凸显了开发能够准确和道德地代表不同种族背景的AI系统的重要性。

Tags