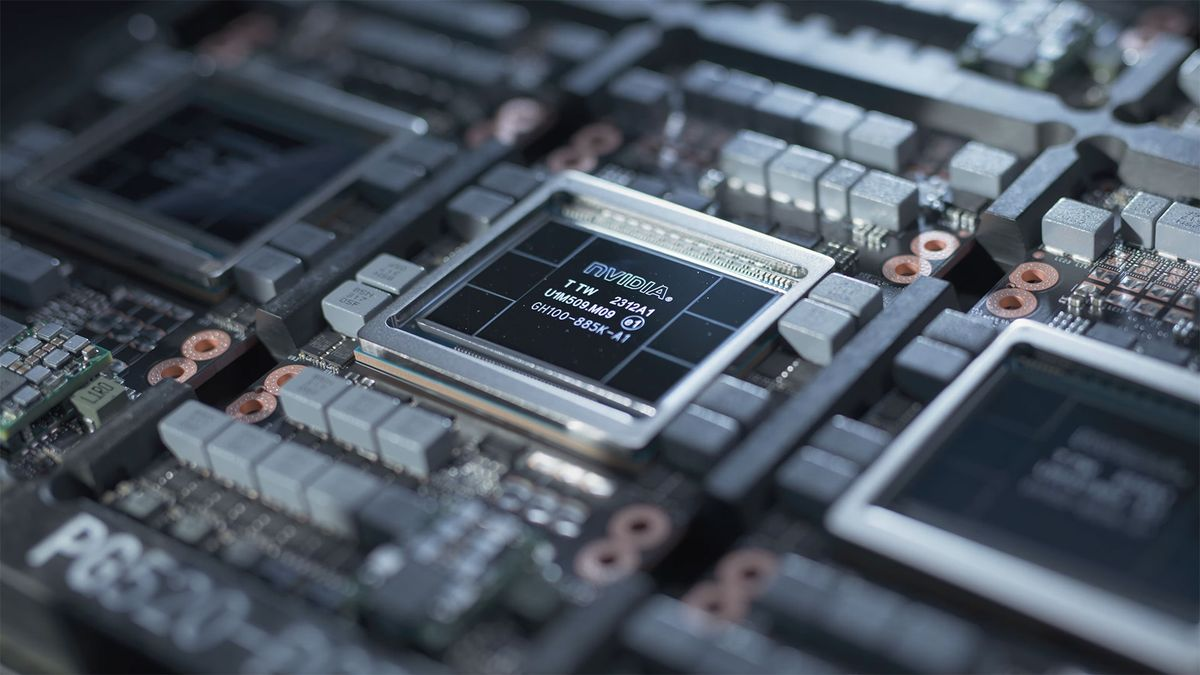

在人工智能和高性能计算应用中,Nvidia H100 GPU供应限制的缓解

快速导读:Nvidia H100 GPU在人工智能和高性能计算应用中广泛使用,其交货时间已从8-11个月大幅缩短至仅需3-4个月。这导致一些公司开始转售或减少对这些处理器的订单。亚马逊网络服务、谷歌云和微软Azure等大型公司的加入,使租用GPU变得更加容易,从而促进了人工智能芯片的供应。然而,自行开发大型语言模型的公司仍面临供应挑战。

H100 GPU稀缺性减少和转售情况

据《信息》报道,有证据表明Nvidia H100 GPU的交货时间已从8-11个月缩短至3-4个月。因此,一些公司现在试图转售其多余的H100 80GB处理器。这些GPU的稀缺性减少以及维护未使用库存的高成本,导致了公司的转售或减少订单。这标志着与前一年相比,获得Nvidia Hopper GPU的困难程度发生了重大变化。

通过云服务提供商改善AI芯片的可用性

亚马逊网络服务(AWS)等云服务提供商在改善AI芯片的可用性方面发挥了作用。AWS推出了一项新服务,允许客户安排短期租用GPU,解决了之前的芯片供应和位置问题。这导致了对AI芯片的需求和等待时间的减少。然而,自行开发大型语言模型的公司仍面临供应限制,特别是在访问用于训练的大型GPU集群方面。几个月的延迟以获取所需的处理器或容量并不罕见。

买家行为的转变和潜在的市场平衡

Nvidia人工智能处理器的供应增加导致买家行为发生了变化。公司在购买或租用上更加注重价格和选择,关注其经济可行性。虽然AMD或AWS等Nvidia处理器的替代品在性能和软件支持方面逐渐增强,但对人工智能芯片的需求仍然强劲。然而,随着供应的改善和对人工智能处理器的谨慎支出的结合,市场在未来可能会更加平衡。

Tags